生成AIの誕生まで 1

キーワード

- 生成AI(ジェネレーティブAI)

- ボルツマンマシン

- 制約付きボルツマンマシン

- 自己回帰モデル

- CNN(畳み込みニューラルネットワーク)

- 畳み込み

生成モデルの誕生

生成AI(ジェネレーティブAI)とは

- 人間が作成したデータを学習し、入力された指示や条件に応じて、新たな文章・画像・音声・動画・プログラムなどのコンテンツを自動生成する人工知能のこと

- ディープラーニング(深層学習)を基盤技術とする応用分野に位置づけられる

- 大量データを扱えるニューラルネットワークを利用している

ジェネレーティブ(Generative)とは

- 「新しく作り出す」「生み出す」 という意味

従来のAI

- 従来のAIは、探索、推論、分類・判別といった「正解を選ぶ」処理が中心であった

- バイナリデータ(0/1)を前提とした学習方法が多く、画像や音声、自然言語といった高次元で連続値を持つ複雑なデータを十分に扱えないという問題があった

ポツルマンマシンの登場

- ボルツマンマシン(BM)は、従来の探索・推論・分類中心のAIが複雑なデータ構造を十分に扱えないという課題を背景に登場した。

- 確率的に振る舞うニューラルネットワークを用い、実数値による多層表現によって高度なデータ学習を可能にし、AI研究が再び注目されるきっかけとなった生成モデルである。

- ボルツマンマシンの課題

- 全結合構造を持つため、計算量が非常に大きい

- 学習できるデータ量が大幅に増えたことで処理に膨大な時間がかかるようになり実用化するには、未完成なモデルとなった

制限付きボルツマンマシン

- ボルツマンマシンの課題を解決するために、制限付きボルツマンマシンが開発された

- 入力層(可視層)と隠れ層からなる2層構造とすることで効率化を図り、

これにより、教師あり学習に加えて教師なし学習も可能(両方が可能)となった

自己回帰モデルとディープラーニ ング(深層学習)

自己回帰モデル(Autoregressive Model)

- 過去のデータを基に、次のデータを順番に予測・生成するモデルである

- 時系列データの分析に適している

ディープラーニング(深層学習)

- 多層構造のニューラルネットワークを用いて、データの特徴を自動的に学習する機械学習手法である

生成モデルとの関係

- ボルツマンマシンやRBMなどの研究を基盤として、ニューラルネットワークの多層化が進み深層学習へ発展した

- これにより、従来のAIでは困難だった高度な認識や生成が可能となった

- ディープラーニングの発展により、画像データの特徴を効率的に抽出するための畳み込みニューラルネットワーク(CNN)が登場し、画像認識分野で大きな成果を上げた

CNN(畳み込みニューラルネットワーク)

CNNとは

- CNNとは、Convolutional Neural Networkの略(Convolutional:畳み込み)

- 画像データの特徴を効率的に抽出するために開発されたディープラーニングの一種である

- 人間が特徴を設計しなくても、画像の特徴を自動的に学習できる

CNNの特徴

- 畳み込み処理

- 画像の一部(局所的な範囲)に注目しながら特徴を抽出する

- エッジや形状などを検出できる

- プーリング(特徴の要約)

- 重要な特徴を残し、情報を圧縮する

- 位置のずれに強くなる

- 局所的な接続

- 全結合ではなく、部分的に結合することで

- 計算量を大幅に削減

生成AIの誕生まで 2

キーワード

- VAE(変分自己符号化器)

- ノイズ

- エンコーダ

- デコーダ

- 潜在ベクトル

- GAN(敵対的生成ネットワーク)

- 生成器

- 識別器

- RNN(回帰型ニューラルネットワーク)

- 隠れ層

- リカレント層

- シーケンスデータ

- LSTM(長・短期記憶)

- Transformerモデル

- Attention層

- 自己注意力(Self-Attention)

- Attention Mechanism

- 位置エンコーディング

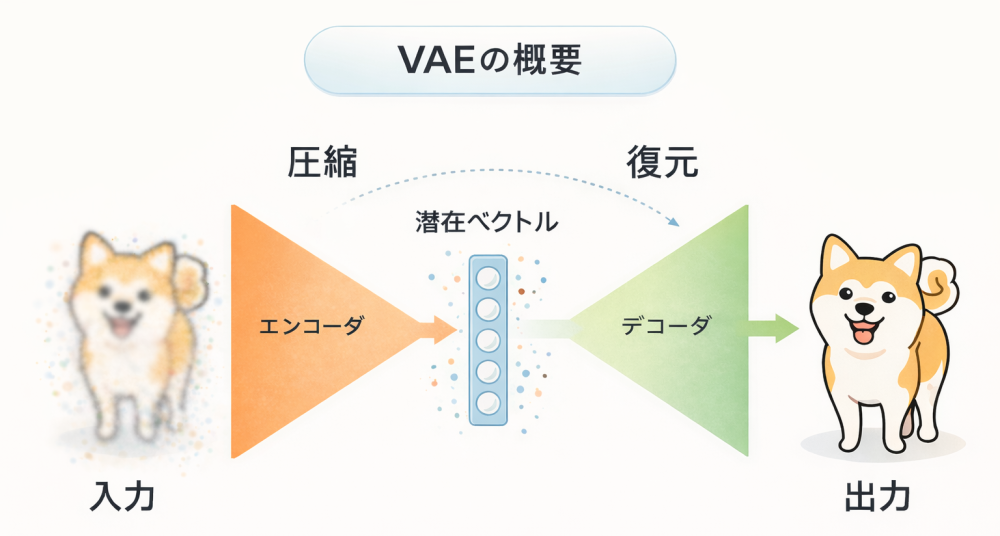

VAE(変分自己符号化器)

- VAEは、データの特徴を学習し新しいデータを生成できる深層学習型の生成モデルである。

- 入力データはエンコーダによって潜在ベクトルに変換され、デコーダによってノイズを含む潜在ベクトルから元のデータに近い出力を再現し、新しいデータ生成も可能となる。

潜在ベクトル

- 画像・文章・音声などの複雑なデータを、AIが理解しやすい「数値のかたまり(ベクトル)」に変換したもの。

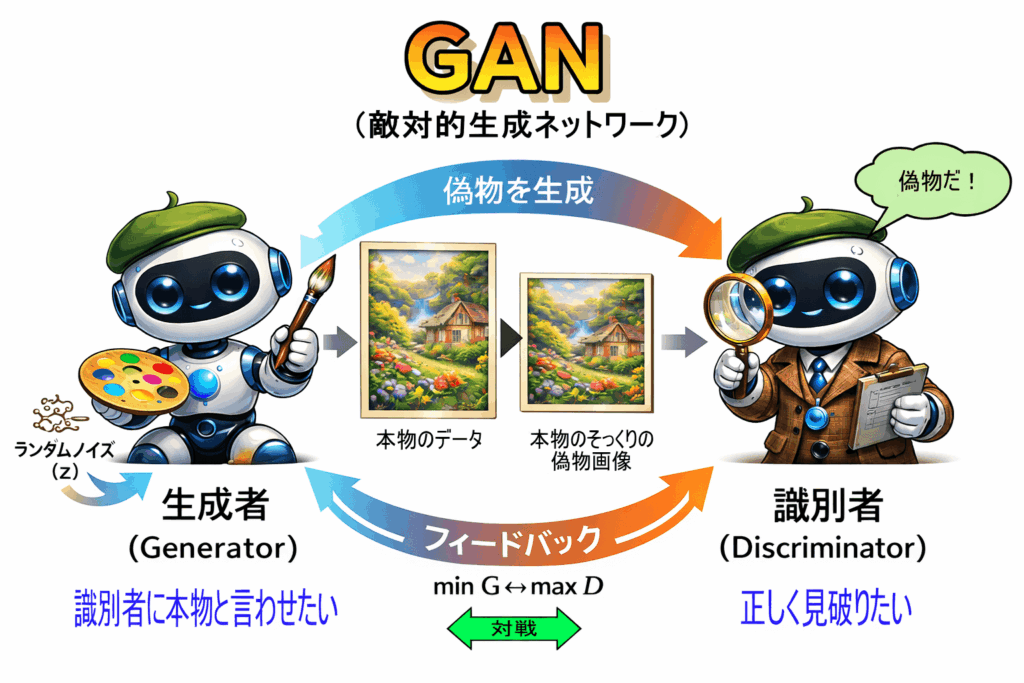

GAN(敵対的生成ネットワーク)

- GAN(Generative Adversarial Network)

- 生成器と識別器が互いに競い合いながら学習することで、高品質なデータ生成を可能にした生成モデルである。

生成器とは

- ランダムなノイズを入力として受け取り、本物のデータに似たデータを生成する

識別器とは

- 入力されたデータが本物か生成されたものかを判別する役割を持つ

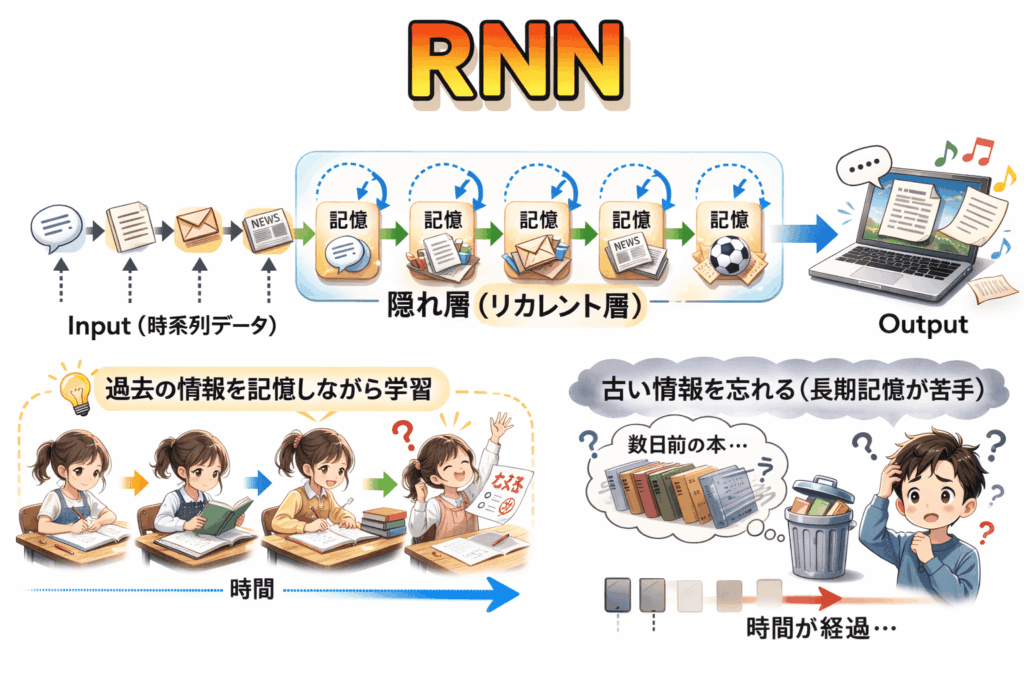

RNN(回帰型ニューラルネットワーク)

- RNN(Recurrent Neural Network)

- 隠れ層にリカレント層を持ち、過去の情報を記憶しながら時系列データの関係を学習できるニューラルネットワークである

- 古い情報を忘れてしまう(長期記憶が苦手)

隠れ層

- 入力と出力の間で特徴を学習する層

リカレント層

- 前の時刻の情報を次に引き継ぐ仕組み

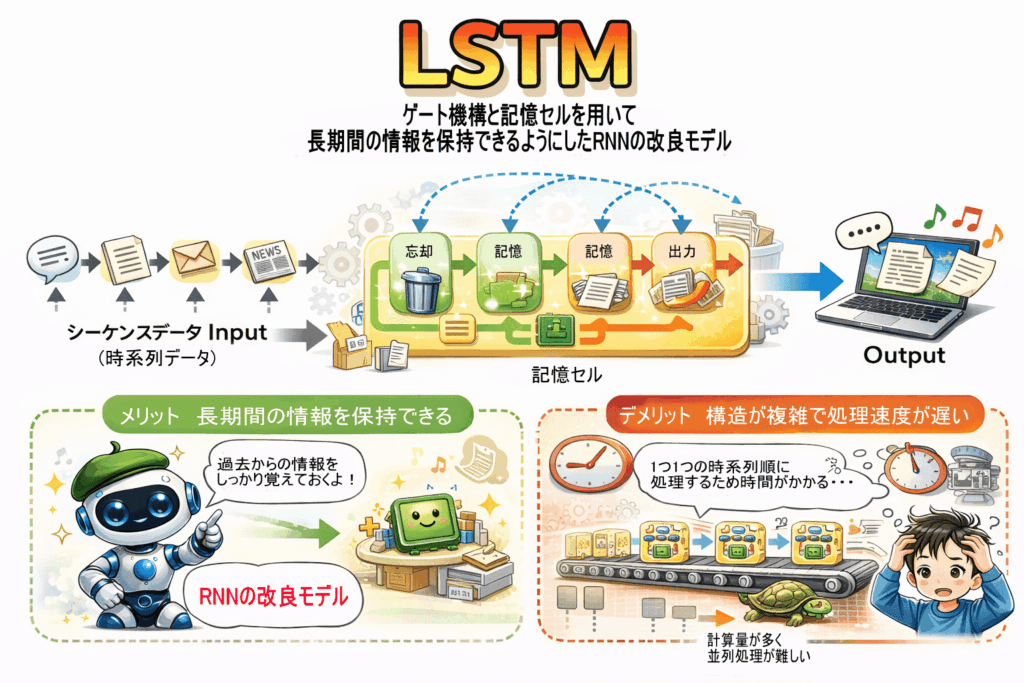

LSTM(長・短期記憶)

- LSTM(Long Short-Term Memory)

- ゲート機構と記憶セルを用いて長期間の情報を保持できるようにしたRNNの改良モデルである。

- シーケンスデータの長期的な関係を学習できる一方で、構造が複雑で計算量が多く、時系列順に処理する必要があるため並列処理が難しく、処理速度が遅いという欠点を持つ

シーケンスデータ

- 時系列や順序を持つデータ

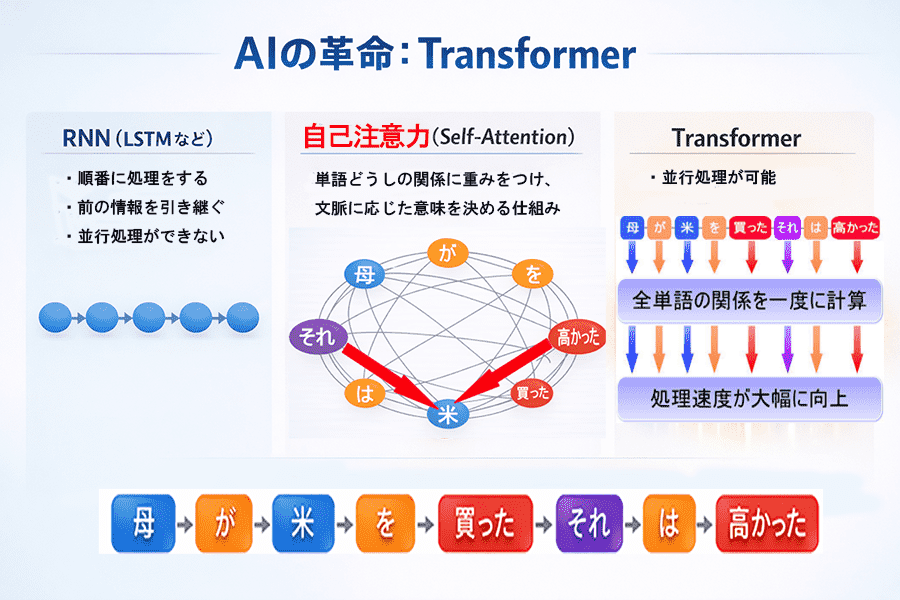

Transformerモデル

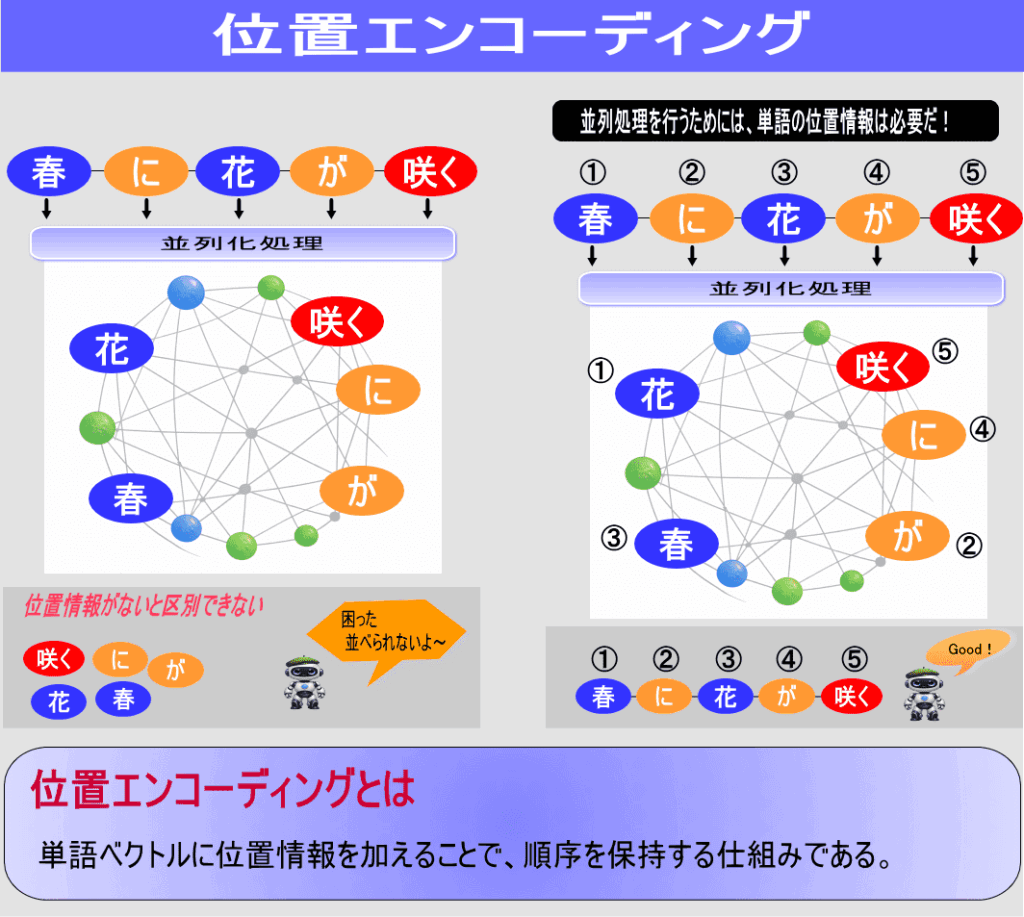

- Transformerは、RNNやLSTMのように時系列順に処理するのではなく、自己注意力(Self-Attention)を用いて入力全体の単語どうしの関係を同時に学習できるモデルである

- この仕組みにより並列処理が可能となり、長距離の依存関係も効率的に捉えられるようになった。

- 一方で、並列処理では単語の順序情報が失われるため、その位置情報を保持するために「位置エンコーディング」を用いる

- Transformerは主にエンコーダとデコーダから構成され、機械翻訳や文章生成などの自然言語処理分野で高い性能を示す

- 現在の生成AI(ChatGPTなど)の基盤技術として広く利用されている

Attention層(構造)

- 入力データ間の関連度を計算し、その重要度に応じて重み付けを行う層である

Attention Mechanism (概念)

- 入力データの中で重要な部分に重みを与える仕組みである

- Transformerでは、このAttention MechanismをSelf-Attentionとして実装している

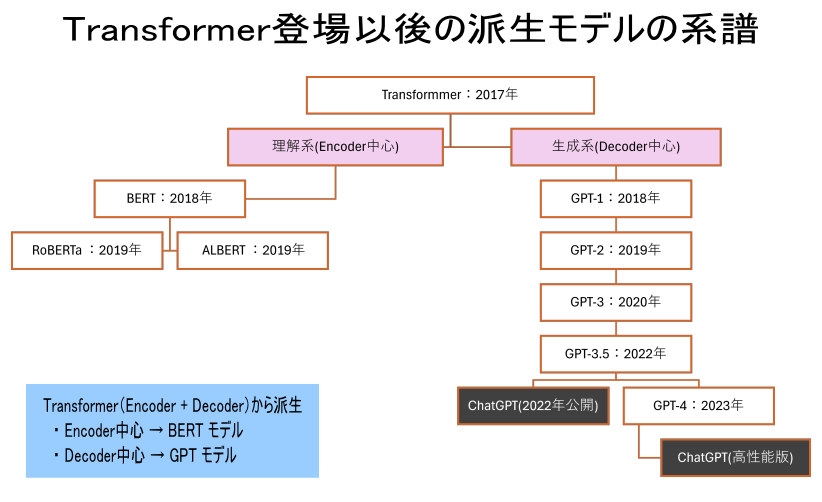

Transformer登場以後の派生モデルの系譜

キーワード

- アーキテクチャ

- GPTモデル

- Open AI

- BERTモデル

- MLM(Masked Language Model)

- NSP(Next Sentence Prediction)

- RoBERTa

- ALBERT(a Lite BERT)

派生モデルの系譜

GPT モデル

- GPT モデルは、Transformerアーキテクチャ(主にDecoder構造)を基盤とする自己回帰型言語モデルで、2018年にOpenAIが開発

- 大量のテキストデータを事前学習し、新しい文章を生成できる

アーキテクチャ

- モデルの構造設計図

OpenAI

- 2015年に設立された米国の人工知能研究機関であり、大規模言語モデルGPTや対話型AI「ChatGPT」を開発した組織である。

BERTモデル

- BERTモデルは、Transformerのアーキテクチャ(主にEncoder構造)を基盤とする双方向型の自然言語処理モデル

学習方法

- MLM(Masked Language Model)

- 文章中の一部の単語を隠し(マスク)、その単語を予測する学習手法

- NSP(Next Sentence Prediction)

- ある文が別の文の直後に来るかどうかを予測する事前学習手法であり、文と文の関係性を学習する

RoBERTa(ロバータ)

- RoBERTaは、Facebook(現Meta)が2019年に発表した、BERTを改良した自然言語処理モデル

- 事前学習データを大幅に増加(BERTの約10倍)させ、長時間の訓練など学習手法を最適化することで性能を向上させた

ALBERT(a Lite BERT)

- ALBERTは、Googleが2019年に発表した、BERTを軽量化(A Lite BERT)した自然言語処理モデル

- パラメータ数を大幅に削減することでモデルの効率を向上させ(軽量化)、低リソース環境でも高い性能を発揮できる

- 【低リソース環境】:低性能なPCやスマートフォン、バッテリー制約のある機器など

用語の整理(レイヤーの違い)

用語の整理

- アーキテクチャ(構造)

- Transformer

- モデル

- GPT-1, GPT-2, GPT-3, GPT-3.5, GPT-4

- BERT など

- サービス/応用

- ChatGPT

コメント